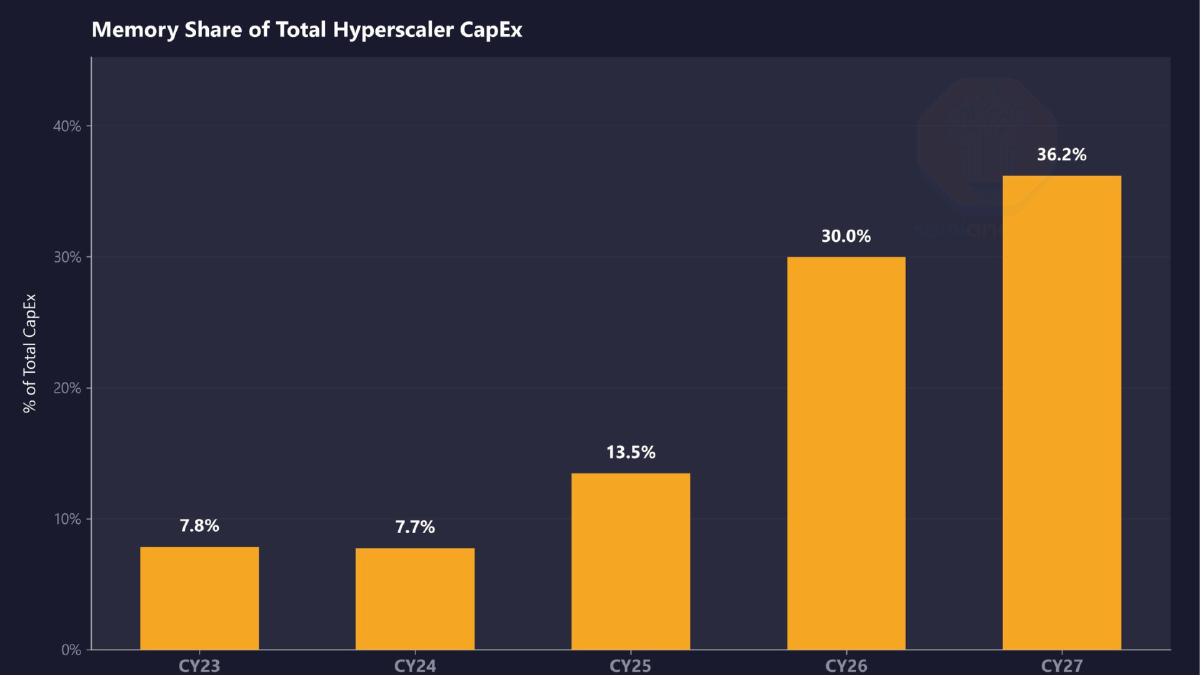

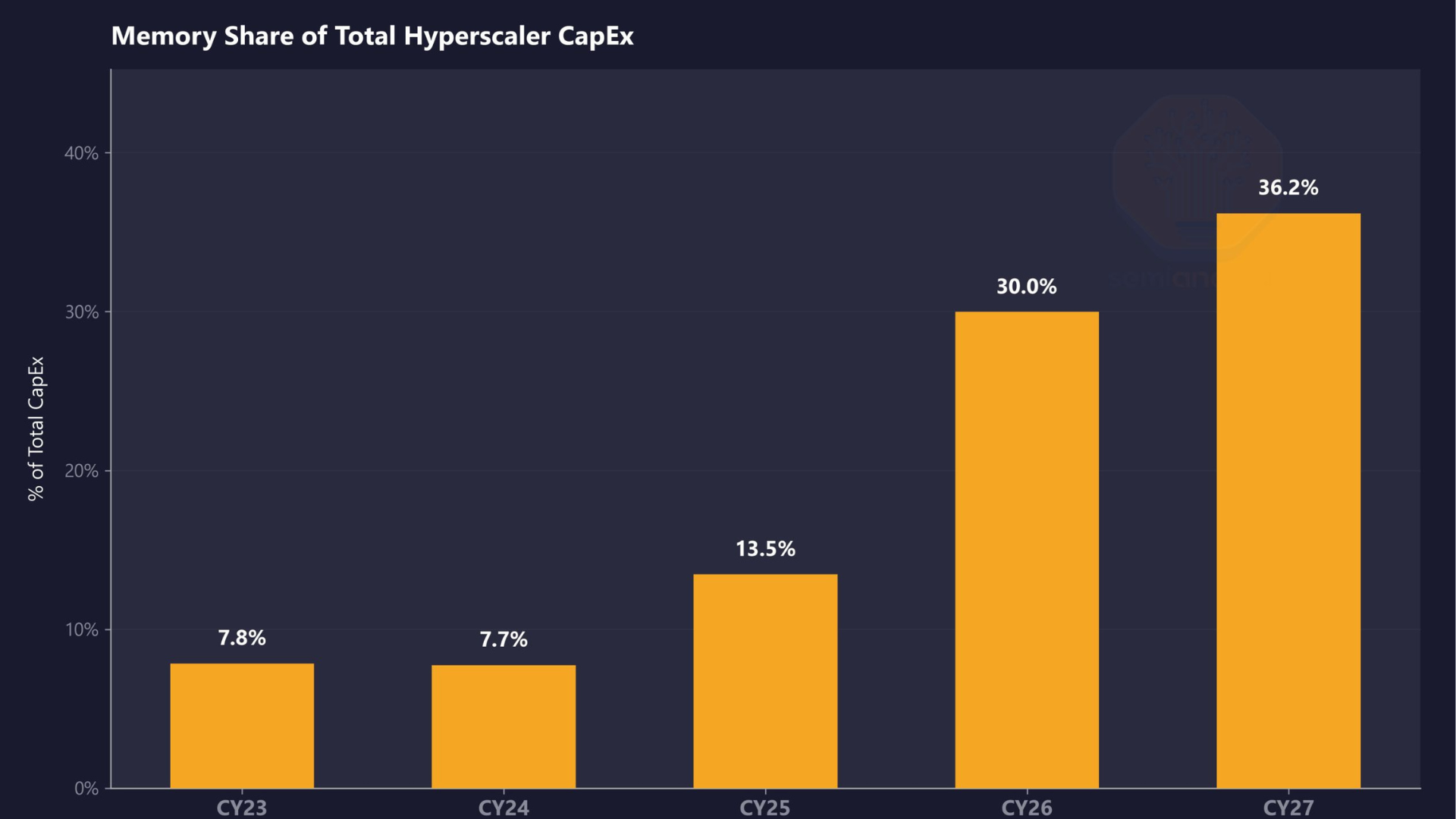

メモリ支出が急激に拡大#

2024年、ハイパースケーラーのAIデータセンターにおける支出の30%をメモリが占めることが明らかになった。これは2023年と比較して4倍の増加となる。

Nvidiaの優遇条件#

アナリスト企業によると、Nvidiaは標準的な市場価格を大幅に下回る優遇的な供給条件を獲得しているという。

技術的背景#

ハイパースケーラーとは、大規模なクラウドサービスプロバイダーやテクノロジー企業を指す用語で、Google、Amazon、Microsoft、Metaなどの企業が該当する。これらの企業は膨大な計算処理能力を必要とするAIワークロードを扱っており、そのためのデータセンターインフラに大規模な投資を行っている。

メモリは、AIの機械学習モデルの訓練や推論処理において重要な役割を果たすコンポーネントで、処理速度と効率に直接的な影響を与える。特にAI処理では大容量の高速メモリが要求されるため、データセンター構築における重要な投資対象となっている。

業界への影響#

メモリ支出の急激な増加は、AI需要の爆発的な成長を反映している。2023年から2024年にかけての4倍という増加率は、AIインフラ投資の規模とスピードを示している。

Nvidiaが市場価格を下回る条件でメモリ供給を受けているという事実は、同社のAI市場における強いポジションを示唆している。これにより、Nvidiaは競合他社に対してコスト面での優位性を保持できる可能性がある。

まとめ#

2024年のハイパースケーラーAIデータセンター支出におけるメモリの割合は30%に達し、前年比4倍の大幅な増加を記録した。この傾向は、AI技術の急速な発展とそれに伴うインフラ需要の拡大を物語っている。また、Nvidiaが獲得している優遇的な供給条件は、AI市場における同社の影響力の大きさを示している。

詳細は元記事を参照されたい。