【結論】何が起きたのか?#

Googleとアメリカ国防総省(ペンタゴン)が、GoogleのカスタムAIチップであるTPU(Tensor Processing Unit)を機密環境で運用するための交渉を行っていることが明らかになりました。この交渉において、Googleは大量監視(mass surveillance)や自律兵器(autonomous weapons)への使用に関して厳格な制御を求めていることが重要なポイントとなっています。

なぜ今話題になっているのか?3つの理由#

1. AI技術の軍事利用が本格化#

GoogleのTPUという高性能AIチップが、ついに軍事・機密分野での活用段階に入ったことを示しています。これまで民間で培われてきたAI技術が、国防分野でも本格的に検討される時代に突入しました。

2. 倫理的制御への新しいアプローチ#

Googleが軍事協力において、監視技術や自律兵器への使用に厳格な制御を求めているのは、AI倫理における新しい企業姿勢を示すものです。技術提供と倫理的責任のバランスを取る新たな取り組みとして注目されています。

3. 機密環境でのカスタムチップ運用という革新性#

TPUを機密環境で運用するという技術的挑戦は、AIインフラの新しい展開を意味します。セキュリティと性能を両立させる技術実装が求められる画期的な取り組みです。

専門家が注目するポイント#

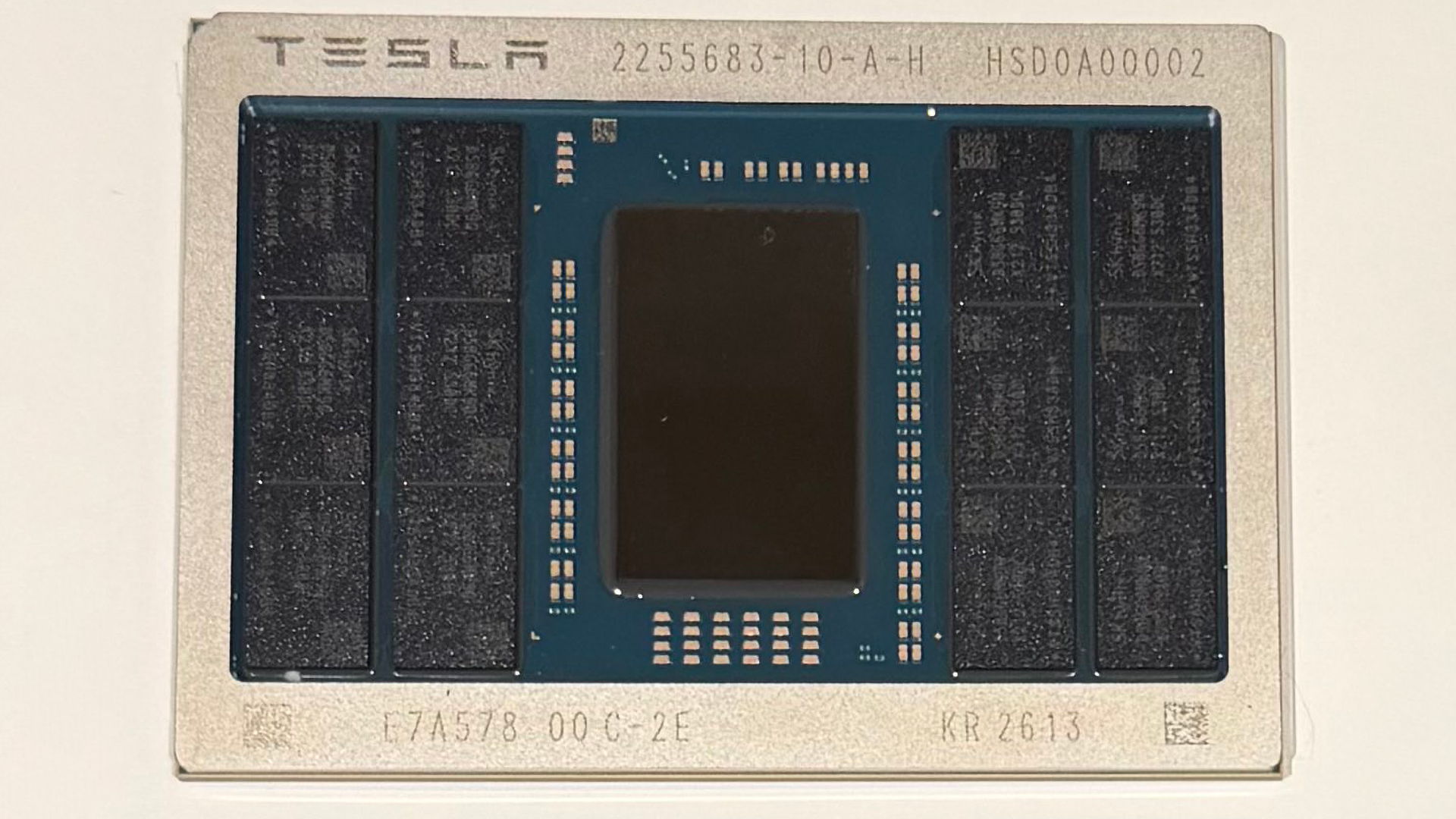

TPU(Tensor Processing Unit)とは、Googleが開発したAI処理に特化したカスタムチップです。機械学習の計算を効率的に実行できるよう設計されており、従来のCPUやGPUと比べてAI処理において高いパフォーマンスを発揮します。

今回の交渉で特に重要なのは、これらの高性能AIチップを「classified environments(機密環境)」で運用するという点です。これは、国家安全保障に関わる極めて機密性の高い環境でのAI活用を意味しており、技術的なセキュリティ要件は非常に厳格になると予想されます。

また、Googleが「tight controls(厳格な制御)」を求めていることは、AI技術の軍事利用における企業の責任ある姿勢を示すものです。特に大量監視や自律兵器への応用に対して制限を設けることで、技術の悪用を防ぐ取り組みが含まれています。

あなたの仕事・生活への影響#

IT・AI業界従事者への影響

- AI技術の軍事応用という新しい市場が開拓される可能性

- 企業のAI倫理ポリシーがより重要になる

- セキュリティ要件の高いAI開発スキルの需要増加

一般ユーザーへの影響

- AI技術の信頼性向上につながる可能性

- プライバシーや監視技術に関する議論の活発化

- 軍事AI技術の民間転用による恩恵の可能性

セキュリティ関連従事者への影響

- 機密環境でのAI運用という新分野の創出

- より高度なセキュリティ技術の必要性

- 軍事グレードのAIセキュリティ基準の確立

よくある質問と答え#

Q: TPUが軍事利用されることで何が変わるのか? A: 詳細は元記事を参照してください。ただし、高性能なAI処理能力が機密環境で活用されることで、国防分野におけるAI技術の応用が大幅に進展する可能性があります。

Q: Googleはなぜ制御を求めているのか? A: 大量監視や自律兵器への使用に対して厳格な制御を求めていることがソースで言及されていますが、具体的な理由については元記事を参照してください。

Q: この交渉の結果はいつ分かるのか? A: 交渉のタイムラインについては、詳細は元記事を参照してください。

まとめ:押さえておくべき重要ポイント#

- GoogleとペンタゴンがTPUの機密環境での運用について交渉中

- 大量監視と自律兵器への使用に厳格な制御を求めるGoogleの姿勢

- AI技術の軍事利用における新しい企業倫理のアプローチ

- カスタムAIチップの機密環境運用という技術的挑戦

- AI業界全体における責任あるイノベーションの重要性

筆者の見解: この交渉は、AI技術が社会に与える影響を企業が真剣に考慮している証拠でもあります。技術の進歩と倫理的責任のバランスを取る新しいモデルケースとして、今後の展開が注目されます。

関連情報・次に読むべき記事#

- AI倫理と軍事利用に関する最新動向

- TPU技術の詳細解説

- 機密環境でのAI運用におけるセキュリティ課題

- Google AI戦略の変遷