GoogleのTPU戦略に大きな転換点が訪れました#

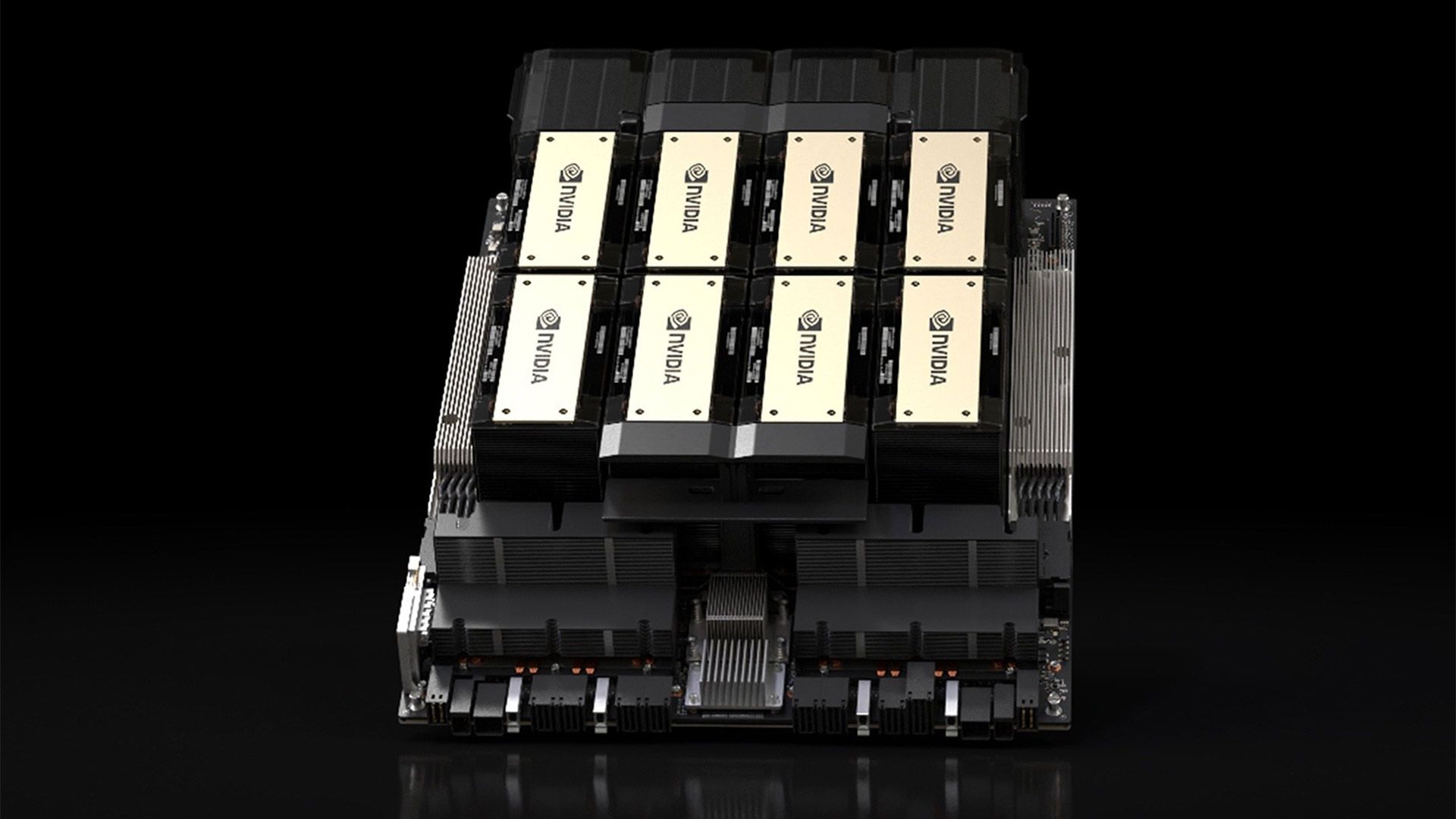

GoogleがTPU(Tensor Processing Unit)V8で初めて採用した2チップ分離戦略が、AI業界に大きな波紋を呼んでいます。この記事では、なぜGoogleがこの戦略転換を行い、Nvidia AI アクセラレーターに対してどのような優位性を狙っているのかを詳しく解説します。

【結論】今回のニュースで分かったこと#

今回明らかになった重要なポイントは以下の通りです:

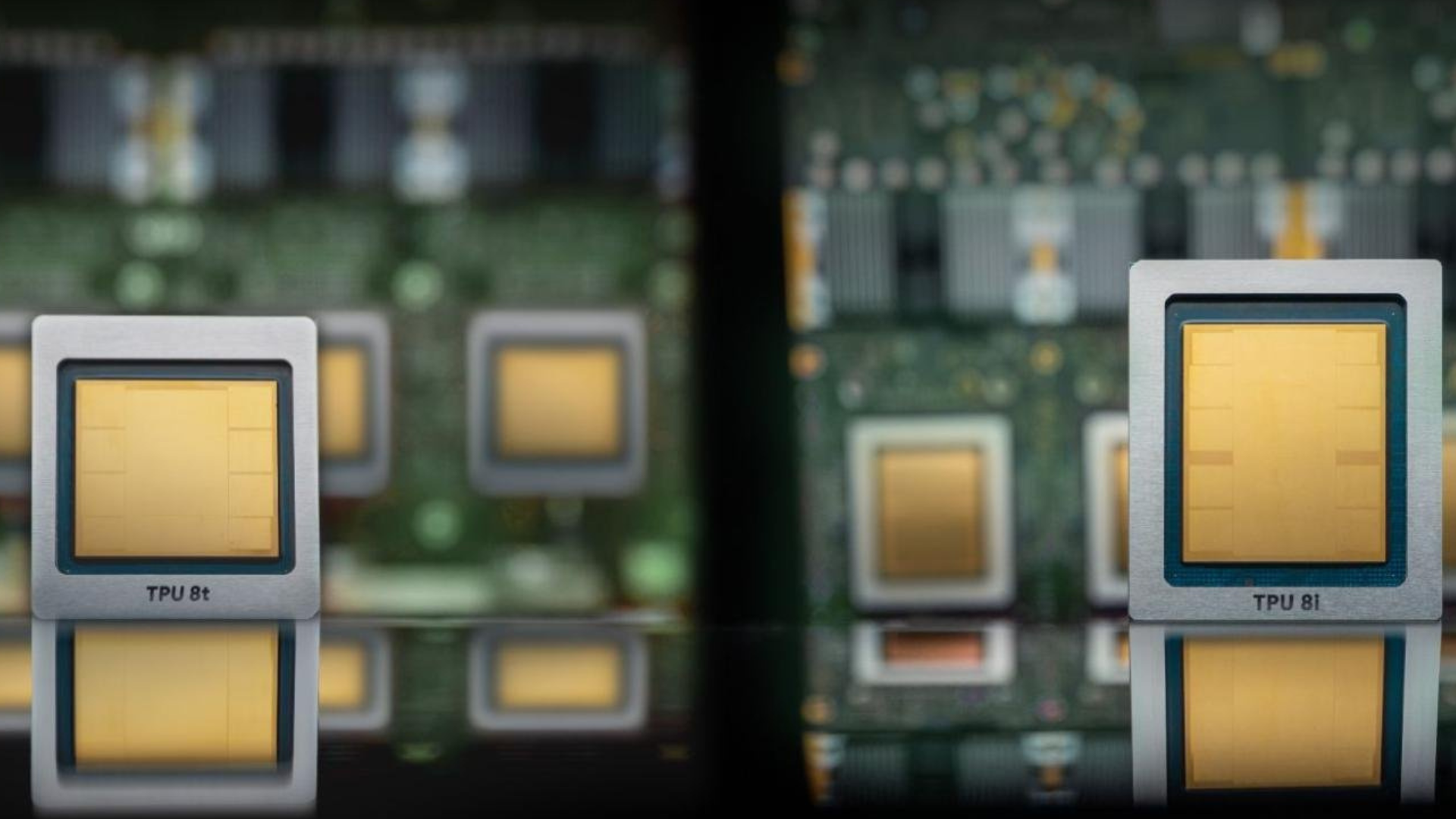

- GoogleがTPU V8で初めて学習用と推論用の2つのチップに分離

- 最大100万TPUという巨大なクラスターでの動作が可能

- この規模はNvidia AI アクセラレーターに対する優位性を狙った戦略

なぜいま注目されているのか#

AI技術の急速な進歩により、機械学習の**学習(Training)と推論(Inference)**では求められる性能特性が大きく異なることが明確になってきました。

これまでGoogleのTPUは統合型のアーキテクチャを採用していましたが、TPU V8では2つの異なるタスクに最適化された専用チップを開発することで、それぞれの処理により適したハードウェアを提供する戦略に転換しました。

技術的なポイントをわかりやすく解説#

学習と推論の違い#

学習(Training):

- AIモデルを作成する段階

- 大量のデータを処理し、パラメータを調整

- 高い計算能力と大容量メモリが必要

推論(Inference):

- 完成したAIモデルを使って実際に予測や判断を行う段階

- リアルタイム性や効率性が重視

- 学習とは異なる最適化が必要

100万TPUクラスターの意味#

Googleが実現した100万TPUという規模は、従来のAIインフラストラクチャーの常識を大きく超える数字です。この大規模なクラスター構成により、これまで不可能だった規模のAI処理が可能になると考えられます。

私たちへの影響は?#

AI開発者・研究者の方へ#

- より効率的なAIモデルの学習が可能に

- 大規模なAIアプリケーションの開発機会が拡大

- Google Cloudを通じたアクセスが期待される

企業のIT担当者の方へ#

- AIサービスのコスト効率化が期待

- より高性能なAIソリューションの導入機会

- クラウドベースのAIインフラの選択肢が拡大

一般ユーザーの方へ#

- GoogleのAIサービスの性能向上

- より高度なAI機能を搭載した製品・サービスの登場

- AI技術の民主化と普及促進

よくある疑問にお答えします#

Q: なぜGoogleはこのタイミングで戦略を変更したのでしょうか? A: 詳細は元記事を参照してください。ソース記事では、この戦略転換がNvidia AI アクセラレーターに対する優位性を狙ったものであることが示されています。

Q: 100万TPUのクラスターはいつから利用できるのでしょうか? A: 具体的な提供開始時期については、詳細は元記事を参照してください。

Q: 他社のAIチップと比較した場合の優位性は? A: ソース記事では、この大規模クラスター構成がNvidia AI アクセラレーターに対する優位性として位置づけられていると報告されています。

まとめ:押さえておくべき重要ポイント#

- 初の2チップ分離:GoogleがTPU V8で学習用と推論用を分離し、各タスクに最適化

- 驚異的なスケール:最大100万TPUという業界最大級のクラスター構成を実現

- 競合への挑戦:Nvidia AI アクセラレーターに対する明確な差別化戦略

- AI業界への影響:今後のAIインフラストラクチャー競争の新たな局面を示唆

- 技術革新の加速:より効率的で大規模なAI処理の実現可能性

筆者の見解: この戦略転換は、GoogleがAIハードウェア分野でリーダーシップを取り戻そうとする重要な一歩と考えられます。2つの専用チップによる最適化と、100万TPUという前例のない規模は、AI技術の進歩を大きく加速させる可能性があります。

参考・関連情報#

より詳しい技術仕様や背景については、以下の元記事をご参照ください。GoogleのTPU戦略の全貌と、今後のAI業界への影響についてさらに深い洞察を得ることができます。